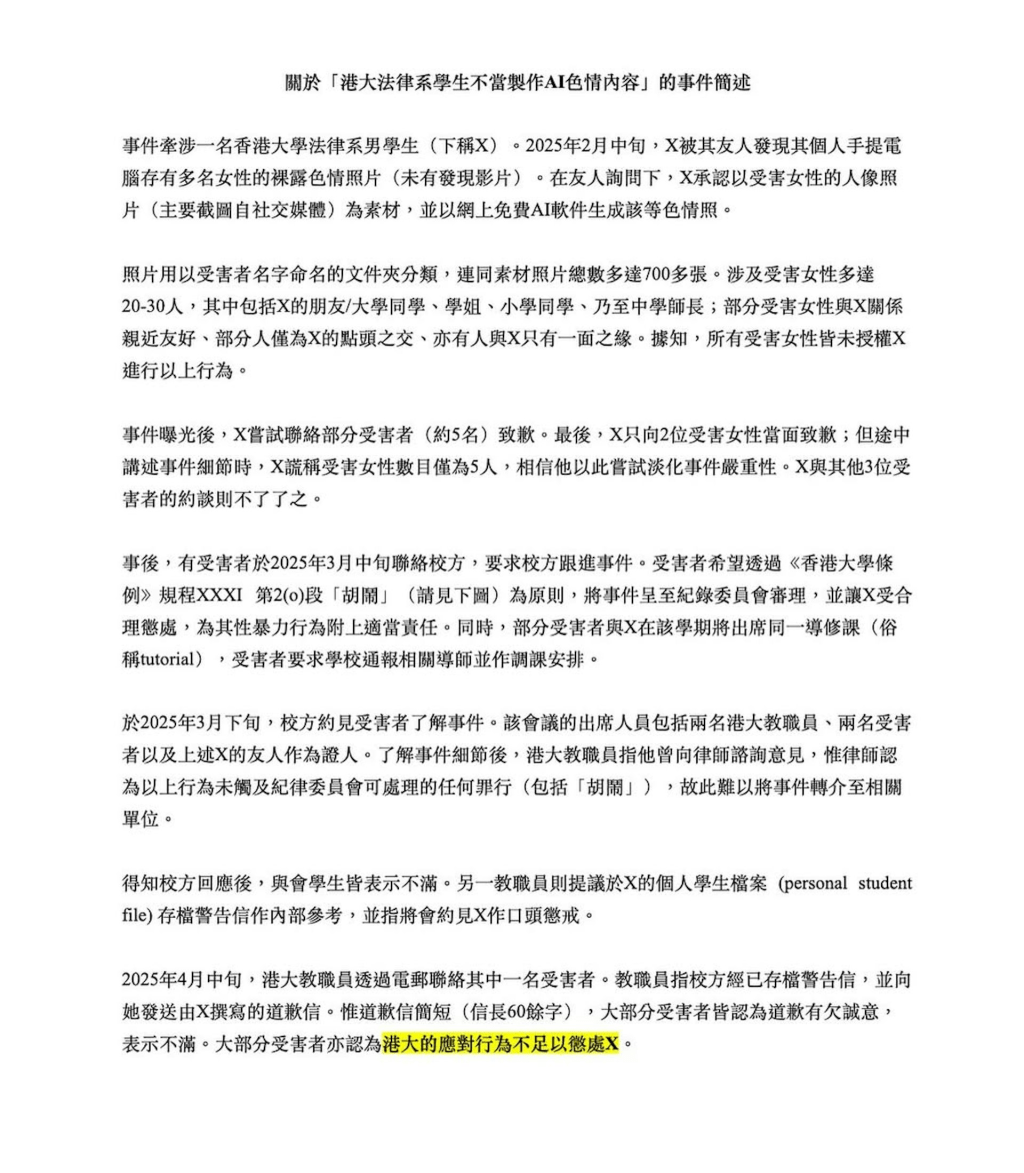

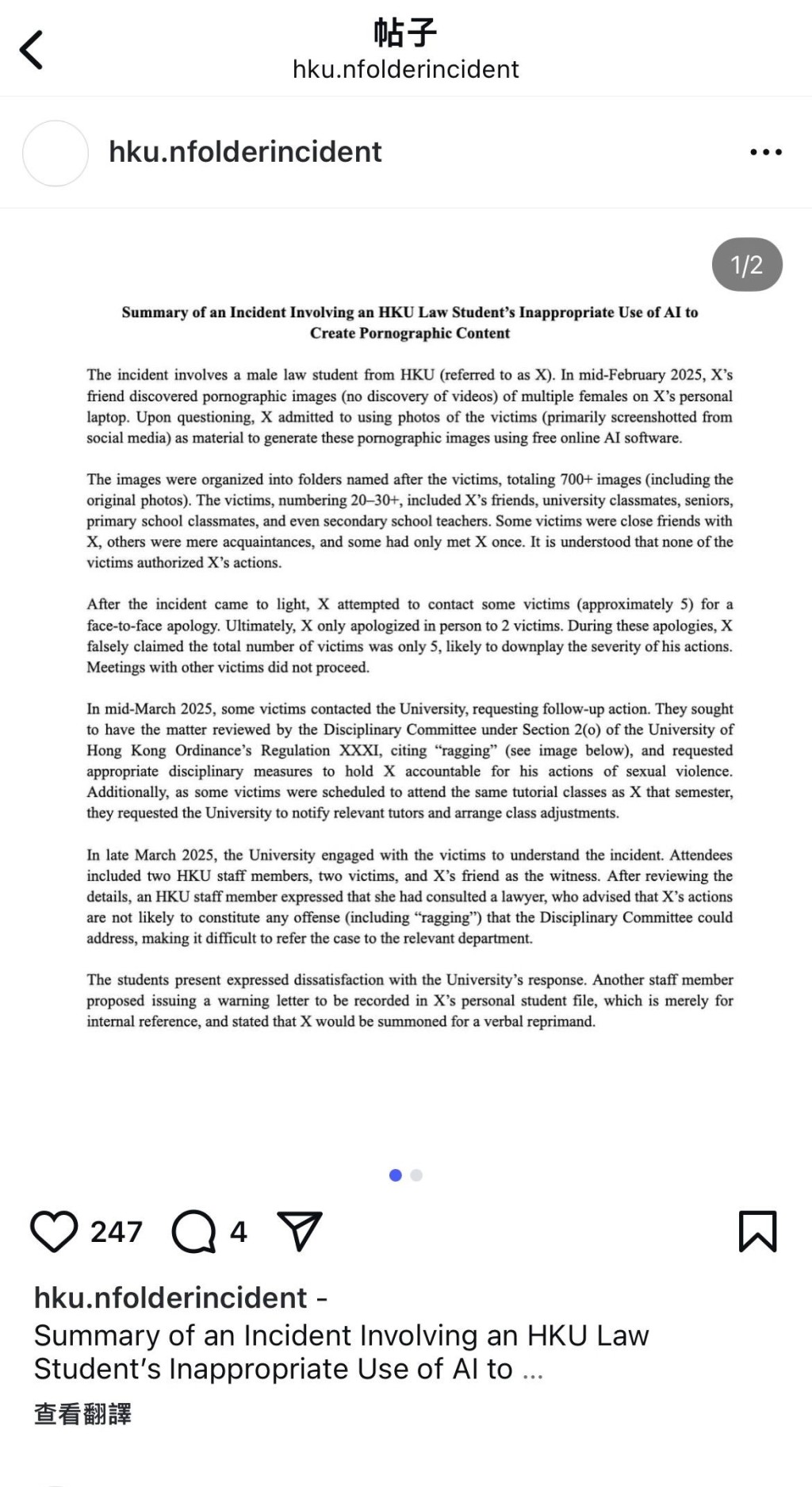

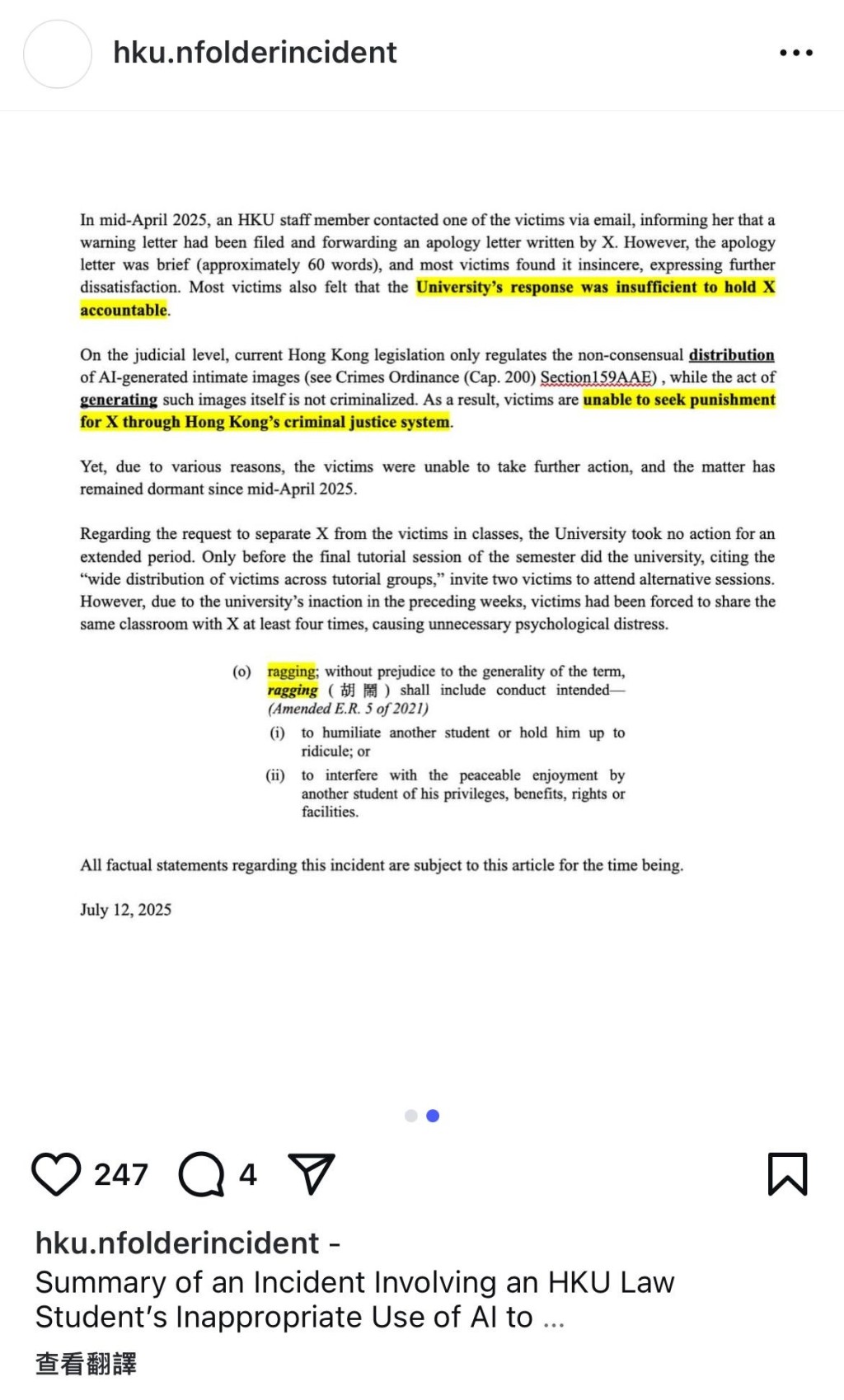

人工智能為人類帶來眾多好處,但背後的安全隱患、法律和道德風險亦不容忽視。近日有報稱港大學生在網上稱,一名法律系男生涉利用人工智能軟件,在未經事主同意下將其樣貌製作成深偽(deepfake)色情圖片,估計電腦內存有多達700張色情照,涉及20至30名女性。港大證實事件,並向涉事學生發警告信,但帖主徵詢法律意見,發現該男生「生成」行為未有觸犯刑事罪行,認為港大處理不足以反映事件的嚴重程度。

深偽色情照問題日趨嚴重

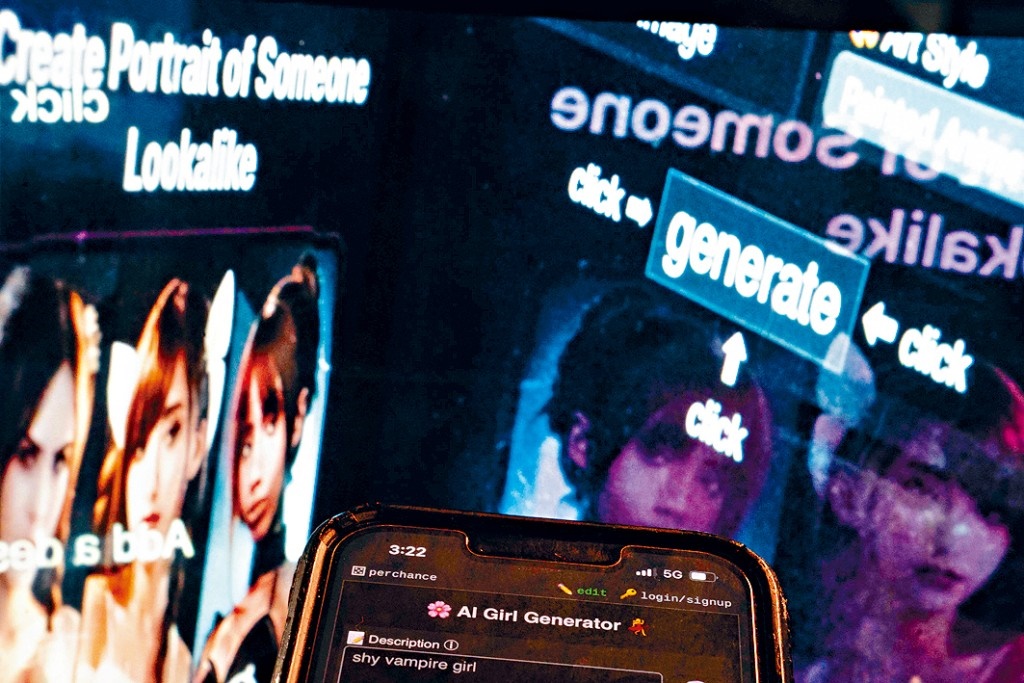

深偽影像問題存在已久,即「移花接木」將當事人樣貌拼合在色情影像,對當事人造成極大心理滋擾,隨着AI技術發展,製作成本越來越低。不過目前法例對於他人私密影像的罪行,只規管未經同意下發布或威脅發布,雖然法例同樣適用於AI修改影像,但只要未經發布,仍無法處理。雖然法例沒禁止儲存他人私密部位影像,但深偽性質有所不同,因圖片屬於偽造,圖內指涉的相關行為未曾發生,本質上屬於誣衊當事人,一旦流出對當事人的創傷難以想像。

相關新聞:

港大生以AI製作同學不雅照片 港大:已發警告信 要求向受影響同學道歉

英、韓已有法例嚴止製作深偽色情照

政府今年對《版權條例》的修訂工作,文件有提及深偽議題,但修例內容只集中於文本開採,涉及知識產權範疇。諮詢期間,有意見指可修訂刑事法,以處理利用深偽技術作性騷擾及色情報復的行為。當時政府回應指,現實世界為防止罪行而制訂的大部分法例,原則上亦適用於數碼世界,視乎每個個案的事實和證據,《刑事罪行條例》上有關未經同意下發布或威脅發布私密影像的相關罪行,也適用於AI生成影像。

科技創新界議員邱達根指,「深偽」定義很闊,廣義來說由最原始「用人手剪兩張相拼埋一齊」,到現時AI生成都包含,但近年AI發展確實令生成行為成本越來越低、仿真度提高,因此要規管深偽色情影像,首先要界定清楚範圍。他指法例不可能涵蓋所有不道德使用科技的行為,目前首要是在科技業界形成共識,從第一步堵塞不當行為,據他了解一些較主流的科技企業已逐步形成共識,先在AI生成作品中,強制規定增加有關標識,協助辨認深偽內容。再進一步,如何在法規層面限制這類色情物品,社會需展開討論。

另一議員江玉歡指,英國、南韓已有相關法例,以英國為例,當地採用「深偽色情內容」(sexually explicit deepfakes)的定義,在既有的窺淫罪的基礎上作增補,明文禁止製作及管有相關內容,與禁制兒童色情物品的嚴厲程度看齊。她認為香港可參照有關做法,在技術上不難處理,但立法會快換屆,未必趕及處理,惟由於問題日趨嚴重,政府應先諮詢社會意見,啟動討論,新議會便可加速處理。

江玉歡指,深偽確實不是新事物,但科技發展令問題出現「質變」,製作成本降低及越趨逼真,對當事人造成極大困擾,形同另類性暴力,今次港大事件更顯示問題已入侵香港社會,不得不處理。她引述南韓立法辯論期間有心理學家指,深偽技術令心智未成熟的青年男女,更易利用錯誤方式處理性慾望,並破壞男女兩性之間互信,需要社會高度關注。她認為除了法律層面,政府亦需審視現時性教育能否與時俱進。

聶風