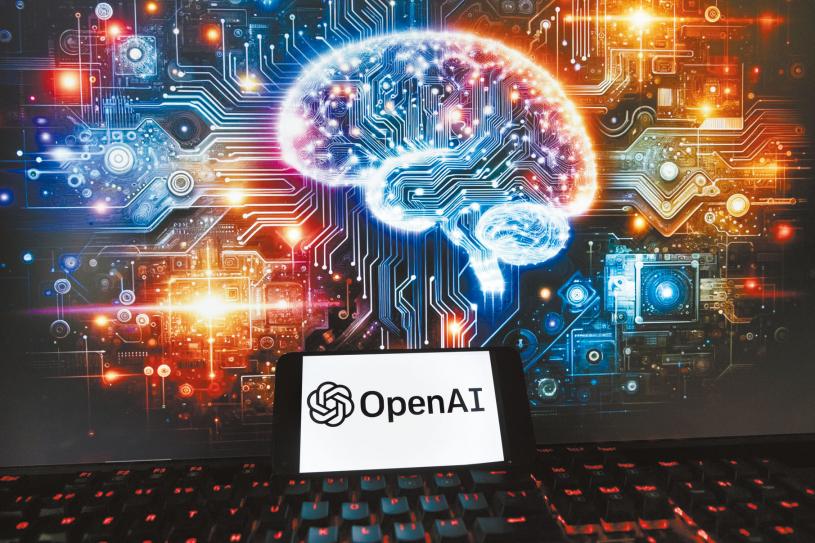

人工智能(AI)公司OpenAI於28日宣布成立一個安全及保安委員會,並開始訓練新的AI模型,將會取代支援ChatGPT AI聊天機器人的GPT-4系統。

OpenAI周二發表網誌透露,新成立的委員會將在「關於該公司的項目和運作的重要安全和保安決定」上,向董事會提出建議。

新成立的委員會由公司內部人員組成,包括執行長阿特曼(Sam Altman)、主席泰勒(Bret Taylor)和四位OpenAI科技及政策專家,及兩名董事德安格洛(Adam D’Angelo)和塞利格曼(Nicole Seligman)。

委員會第一項工作是評估和進一步發展OpenAI的流程和防護措施,並於90天內提出建議。該公司表示,將以「符合安全和保安的方式」對外公開它所採納的建議。

新委員會成立之時,正值外界關注OpenAI產品的安全。這是源於該公司近日人事變動和決策,包括資深研究員雷克(Jan Leike)日前辭職,並批評OpenAI任由「將安全屈服於閃亮的產品下」。OpenAI聯合創辦人兼科學長蘇特克韋爾(Ilya Sutskever)也宣布離開公司,兩人共同負責應對風險的部門「超級對齊」(Super Alignment)也遭裁撤。

雷克28日宣布加入由前OpenAI高層創立的AI公司Anthropic,「繼續『超級對齊』的任務」。

OpenAI表示,近日開始訓練下一代「前沿AI模型」,其AI模型在能力和安全上領先同業,但沒有提及任何爭議,同時歡迎外界為此展開辯論。

AI模型透過訓練進行預測,繼而產生文字、影像和仿真對話,其中「前沿模型」能力最強和最先進。美聯社電