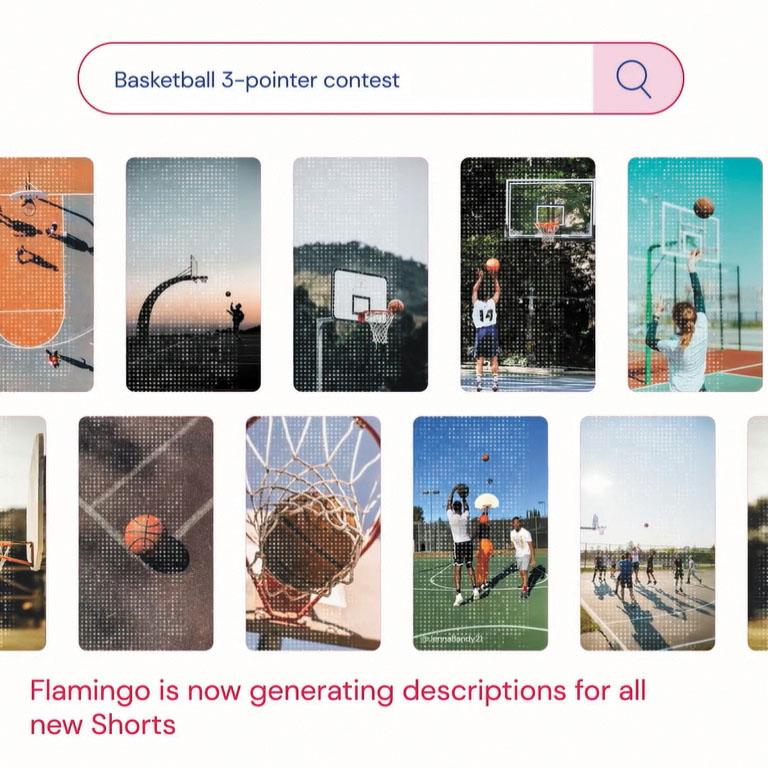

由DeepMind和Google Brain合併的大型人工智能(AI)團隊Google DeepMind,最新分享其研發的視覺語言模型(visual language model,VLM)「Flamingo」(火烈鳥),如何為YouTube Shorts短片生成內容描述,有助提高短片的曝光度。

DeepMind去年一則網誌提到,「Shorts只需數分鐘內就能製作出來,往往沒有包含描述和有用標題,要搜尋它們變得比較困難」。火烈鳥模型透過分析一條短片的初始影格,解釋發生何事來作出描述,DeepMind以一隻狗頭頂著一疊餅乾作為例子。文字描述將被儲存為元數據(metadata),「更好對短片進行分類,並將搜尋結果與觀眾查詢進行匹配」。

這解決了一個真正問題。Google DeepMind業務長默多克(Colin Murdoch)向科技新聞網站The Verge表示,對於Shorts來說,創作者有時沒有加入元數據,是因為製作短片的程序比製作長視頻更精簡。YouTube Shorts產品管理主任謝曼(Todd Sherman)補充,在Shorts短片主要出現的動態頁面上,人們只會迅速滑過去看下一部,而非主動去看它們,因此創作者沒有太多動機加入元數據。

謝曼說︰「這款火烈鳥模型有理解這些短片和提供我們描述文字的能力,對於我們一直在尋找這種元數據的系統來說真的很有價值。它(模型)容許它們更有效地理解這些短片,繼而在用戶尋找時能夠作出匹配。」

這些產生的描述不會面向用戶。謝曼解釋,這些是幕後的元數據,「不會向創作者展示,投入很多努力確保這是準確的」。當被問及谷歌如何確保這些描述是準確時,謝曼回答,「所有描述文字將與我們責任標準一致,非常不可能產生以負面角度描述短片的描述文字,那完全不是我們預期的結果」。

DeepMind 發言人表示,火烈鳥模型已為新上傳的Shorts短片自動產生描述文字,也有用於大量現有短片,包括觀看次數最多的那些。本報訊